作者:王仁蔚、李佳蓮、陳健倫、王俞程、鄭詠珈、李志中

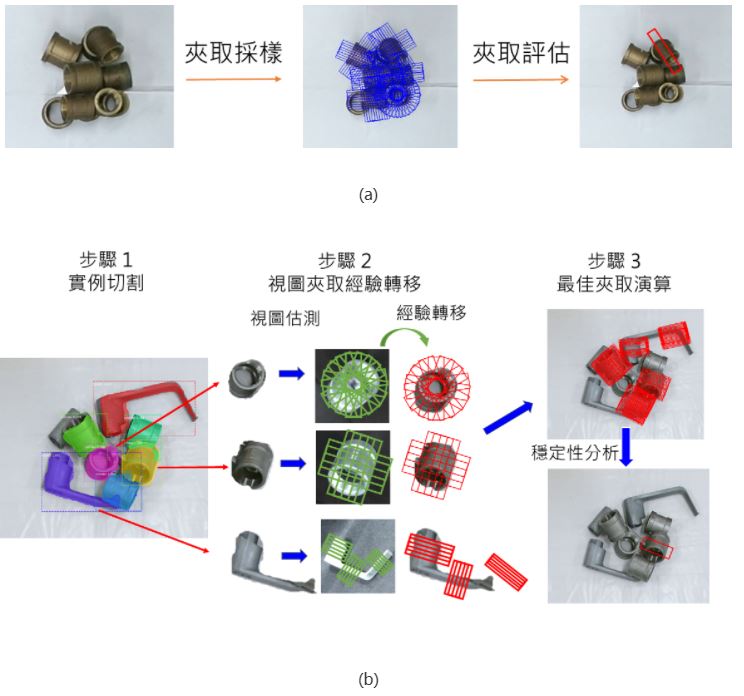

在機器人夾取物件的領域中,夾取點的尋找是一個的重要問題。如何尋找夾取點之演算法在密集堆疊的場景中常面臨一些挑戰,許多研究也提出廣泛的解決方案。夾取點的尋找,通常包含兩個步驟: 採樣與評估,如圖1(a)所示。採樣演算法根據圖像或點雲提出一些可夾取候選點,評估演算法則從中選定最佳的點,且該點可以抵抗意外的干擾並在夾取過程中避免與相鄰物件發生碰撞。換句話說,一個能提出最佳夾取點的演算法須能確定每次夾取皆可行且穩定。

一些研究[1]採用接觸力學模型並根據物體與夾爪間的物理特性來定義夾取的穩定性與可行性。但是這些方法極依賴物件的CAD模型,且評估步驟通常很耗時。為了克服這些限制,最近的研究利用深度學習開發了可有效確定圖像與夾取之間關係的模型。在此種方法中,因複雜的隨機堆疊場景,通常需要大量的標註資料來獲得可靠的模型。此外,該深度學習模型無法決定多個候選夾取點且無法消除遮擋及雜訊對圖像的影響。更重要的是,因其依賴深度學習模型的輸出,該方法通常無法選擇可靠的夾取點或避免與相鄰物件發生碰撞。

為了解決這些問題,本文提出一套新的夾取流程。如圖1(b)所示,在步驟一中,本文採用Mask R-CNN模型從RGB影像中取得切割的影像。接著,使用降噪自動編碼器(Denoising auto-encoder)來學習物件視圖(Object view)的全域描述符(Global descriptor),並找出每個切割影像的對應視圖。在此步驟中,我們為每個物件視圖建立規定的夾取經驗,並將其轉移到切割的影像,以便找到可行的夾取區域。在最後一步驟,演算法會排除與相鄰物件碰撞的夾取區域並以最穩定的夾取點作為最佳選擇。此三階段夾取流程可實現於使用二指平行夾爪與RGB-D Kinect V2相機的機器手臂系統。

圖1 三步驟演算法概述 (a) 夾取點的尋找通常由兩個過程組成:即夾取採樣與夾取評估(b)本文的夾取流程:

步驟1:將容易夾取的物體從雜亂的場景中切割出來;

步驟2:找到每個切割物件所對應的視圖,並將夾取經驗(矩形框)轉移到每個切割物件;

步驟3:刪除夾取過程中會造成碰撞的夾取點,並根據夾取穩定性來確定最佳夾取點。

相關之研究

1.夾取偵測

夾取偵測流程通常包含夾取採樣及夾取評估。Liu等人[2]主要著重在姿態估測上而非夾取候選的採樣。在CAD模型中預先標註特定的夾取方式,在適當地評估每個物件在場景中的姿態後,選擇預先定義好之夾取。但是在雜亂場景下,特定夾取點可能被遮擋以致無法夾取。Mahler等人[3]使用接觸力學模型來評估每個夾取。這些模型基於物件及夾具的物理性質,例如幾何形狀、表面摩擦力及質量分布等在模擬器中定義每個夾取的品質。這些方法很少去研究如何採樣出場景中每個物件的可行夾取,且評估過程通常耗時又不準確。在真實環境中,因為物理性質通常未知,或目標物件的3D點雲不完整以致難以計算等因素,易導致接觸力學模型不準確。